En los últimos años, los avances en inteligencia artificial generativa aparentemente han convertido la “IA” en una palabra de moda que define toda una nueva generación de herramientas con usos claros y reales. Desafortunadamente, no es oro todo lo que reluce.

Muchas empresas ya han comenzado a usar sistemas generadores de imágenes como DALL-E y Stable Diffusion para crear su propio departamento de arte interno de bajo costo (y normalmente a costa de robar sus obras a los artistas reales). El chatbot ChatGPT de Open AI ha hecho a muchos soñar con un futuro de Internet lleno de asistentes digitales sofisticados capaces de dar consejos y escribir textos por ellos. Algunos incluso creen que ChatGPT podría desbancar al mismísimo buscador de Google. Aunque gran parte de la conversación sobre la IA se centra en los datos sin procesar y en el poder de cálculo, sería un error muy grave separar estas herramientas de los humanos.

De hecho, se da la circunstancia de que, desde sus inicios, las supuestas herramientas de IA siempre se han basado en humanos moviendo los hilos entre bambalinas, etiquetando imágenes en silencio, clasificando datos y emitiendo juicios morales y políticos que pueden parecer triviales para los vivos, pero que siguen siendo imposibles para las máquinas.

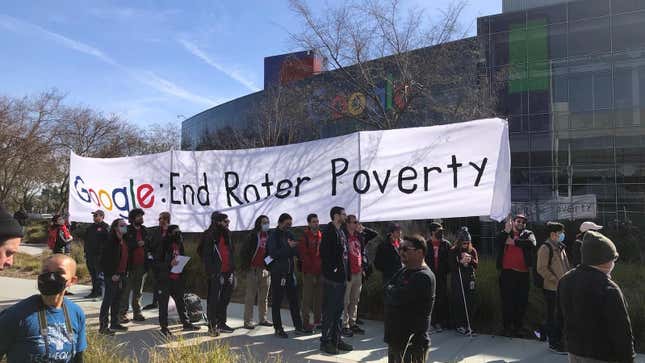

2023 está a punto de convertirse en un año excepcional para la IA, con nuevas empresas que se apresuran a presentar sus sistemas generativos, y empresas veteranas como Google y Meta que probablemente cedan cada vez más el timón a sus sistemas automatizados. La ola de hype hace que sea aún más importante detenerse un momento y reconocer a los seres humanos que trabajan para hacer realidad la magia y ponen la I en la IA.